Lendo agora: Conheça Eliza, chatbot criado em 1960, e saiba o que mudou desde então

-

01

Conheça Eliza, chatbot criado em 1960, e saiba o que mudou desde então

Conheça Eliza, chatbot criado em 1960, e saiba o que mudou desde então

A inteligência artificial (IA) é uma tecnologia que possibilita que máquinas adquiram conhecimentos por meio de experiências, se adaptem às condições e consigam desempenhar tarefas como os seres humanos. Uma delas é o chatbot, um software que tenta simular um ser humano em bate-papo. Ele pode conversar a respeito de praticamente qualquer assunto.

Em novembro de 2022, o lançamento do ChatGPT começou uma nova era na maneira como as pessoas interagem com a tecnologia, principalmente com a IA. Contudo, ao contrário do que muitos podem pensar, os chatbots não são uma novidade.

Tanto é que a primeira invenção desse tipo foi feita na década de 1960: a Eliza. Esse chatbot foi criado para responder perguntas dos usuários, mas tinha alguns truques por trás. Desde que ela surgiu muita coisa mudou, contudo, a relação humanos-tecnologia continuou, essencialmente, a mesma.

Primeiro chatbot do mundo

Olhar digital

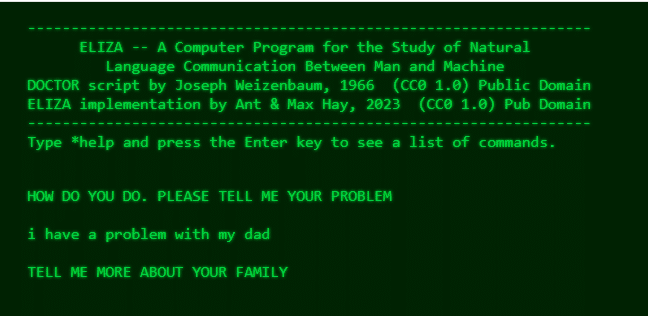

O nascimento do primeiro chatbot do mundo aconteceu em 1966, quando o professor do MIT, Joseph Weizenbaum, construiu a Eliza. Em 1955, ele tinha publicado em um jornal acadêmico que a Eliza “torna possíveis certos tipos de conversa em linguagem natural entre homem e computador”.

Depois disso, o professor configurou seu chatbot para conversar como se fosse um terapeuta, para quem as pessoas iriam poder desabafar a respeito dos assuntos mais profundos.

Contudo, como a época era a década de 1960, para que Eliza conseguisse funcionar eram precisos alguns truques. Por exemplo, quando as pessoas mandavam mensagem para o chatbot, ele selecionava várias respostas predefinidas baseadas na palavra-chave da pergunta ou afirmação. Ou seja, Eliza não dizia realmente nada, ela só repetia o que foi dito e mudava a ordem para passar a impressão de que estava acontecendo uma conversa.

De acordo com o exemplo dado pelo The Verge, se uma pessoa enviasse “meu pai é o problema”, a Eliza respondia com “seu pai é o problema”.

Mesmo ela parecendo uma farsa, na época, funcionou. Depois de um ano do seu lançamento, Weizenbaum escreveu outro artigo mostrando como as pessoas acreditavam que existia um ser humano por trás do chatbot.

Isso mostrou que as pessoas querem uma conexão, nem que seja com uma máquina. E quando elas veem características minimamente humanas, sejam nos chatbots ou em outras tecnologias, elas começam a tratá-las com uma simpatia e compreensão maior, e até a corrigir se ela estiver errada.

Tecnologia

Olhar digital

O primeiro problema na tecnologia de chatbots era a complexidade em criá-las e mantê-las. Para se ter uma ideia, o chatbot da Xerox PARC, da década de 1970, foi criado para ajudar as pessoas a reservarem passagens aéreas, contudo, ele era tão lento e caro para operar que acabou caindo em desuso.

Esse problema foi resolvido com o passar do tempo e essas tecnologias ficaram mais populares. No entanto, a relação humano-máquina não mudou.

Alguns exemplos de chatbot que chegaram com a promessa de falar com a pessoa “como um ser humano” e ajudá-lo no seu dia a dia foram a Siri, Alexa e Bixby. A IA mudou uma boa parte disso e trouxe mais funcionalidades para os chatbots

Tanto é que, ChatGPT, Claude, Copilot e Gemini têm habilidades e intenções relativamente parecidas, mas o objetivo ainda é ser capaz de criar uma conexão com a pessoa para que ela acredite que está realmente sendo ajudada.

Um exemplo disso é o Copilot da Microsoft. A empresa quer que esse chatbot seja “seu companheiro de IA do dia a dia”. Isso mostra que o futuro dos chatbots pode realmente ser o que Weizenbaum propôs, ou seja, um vínculo de conexão humano.

Funcionamento

Ília

Por ser uma inteligência como uma pessoa, várias vezes quem o usa pode acabar se confundindo e tratando o chatbot como se fosse uma pessoa. Mas será que dizer por favor também funciona com robôs?

Essa questão tem se tornado mais popular na internet nos últimos meses. Por conta disso, muitas pessoas estão fazendo testes com algum chatbot e os resultados disso surpreenderam. Foi visto que a inteligência artificial realmente reage melhor quando ela é tratada com educação.

Há seis meses, esse tópico foi um assunto visto no fórum Reddit. E em novembro do ano passado, os cientistas da Microsoft, da Universidade de Pequim e da Academia Chinesa de Ciências descobriram que os chatbots em geral têm um desempenho melhor quando são tratados de uma maneira que transmita urgência ou importância.

Esses pesquisadores fizeram vários testes e conseguiram identificar melhores respostas dadas pelo ChatGPT quando eles escreveram coisas como “É crucial que eu seja entendido” ou “Isso é muito importante para minha carreira”.

O ChatGPT não foi o único caso. Tanto é que uma equipe da Anthropic, que é uma startup de IA, evitou que o seu chatbot chamado Claude desse respostas preconceituosas com um pedido para que esse robô “realmente, realmente, realmente” não fizesse isso.

Uma descoberta feita pelos cientistas do Google foi que dizer a um grande modelo de linguagem para “respirar fundo” fez com que ele resolvesse de forma melhor os problemas matemáticos que eram desafiadores.

No próprio Reddit um usuário disse que um robô agiu melhor depois de ele ter prometido um prêmio de 100 mil dólares.

Esse tipo de interação com o chatbot está sendo chamado pelos cientistas de “instruções emotivas”. De acordo com eles, é bem fácil confundir as coisas por conta das formas humanas convincentes que os chatbots conversam e agem.

Mesmo assim, os pesquisadores garantem que as máquinas não têm emoções. Eles também ressaltam que os modelos generativos de IA não têm realmente inteligência real. Eles são sistemas estáticos que conseguem prever palavras, imagens, fala, música ou outros dados conforme determinado esquema.

De acordo com Nouha Dziri, pesquisadora do Instituto Allen de IA, o motivo está no treinamento que esses LLMs passam.

“Os modelos são treinados com o objetivo de maximizar a probabilidade de sequências de texto. Quanto mais dados de texto eles veem durante o treinamento, mais eficientes eles se tornam na atribuição de probabilidades mais altas a sequências frequentes. Portanto, ‘ser mais gentil’ implica articular suas solicitações de uma forma que se alinhe com o padrão de conformidade no qual os modelos foram treinados, o que pode aumentar a probabilidade de entregar o resultado desejado”, disse ela.

Fonte: Olhar digital

Imagens: Olhar digital, Ília

Post Anterior

Próximo Post

-

01A Terra está dentro do vazio? Explicação responderia enigma da expansão do universo

-

02Leviatã é o pior monstro da bíblia

-

03Foto de 83 milhões de pixels do sol foi tirada por sonda

-

04‘The Last of Us’ da vida real? Cogumelo cresce em sapo e intriga cientistas

-

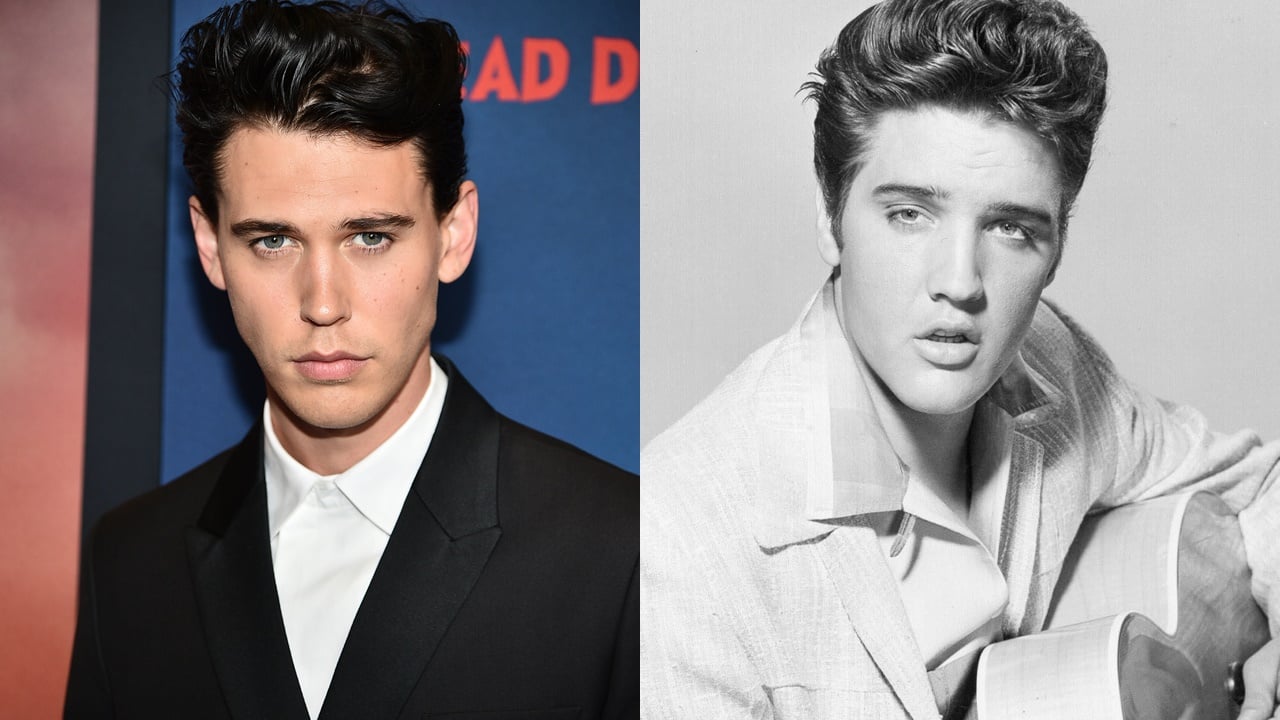

05Filme sobre Elvis Presley não retrata o uso de substâncias médicas restritas

-

06Divulgado o primeiro trailer de Planeta dos Macacos: A Guerra!

-

07Artista ilustra transtornos mentais como sendo monstros