Lendo agora: Presidente da Microsoft quer encontrar maneira de ”desligar a IA”. Entenda

-

01

Presidente da Microsoft quer encontrar maneira de ”desligar a IA”. Entenda

Presidente da Microsoft quer encontrar maneira de ”desligar a IA”. Entenda

A inteligência artificial (IA) é uma tecnologia que dá às máquinas a possibilidade de terem conhecimentos através de experiências, e permite que elas se adaptem ao seu meio e desempenhem tarefas quase da mesma maneira que um ser humano faria. A princípio, isso é uma ótima ideia. No entanto, ninguém sabe ao certo até onde essa tecnologia pode nos ajudar ou então ser a nossa ruína.

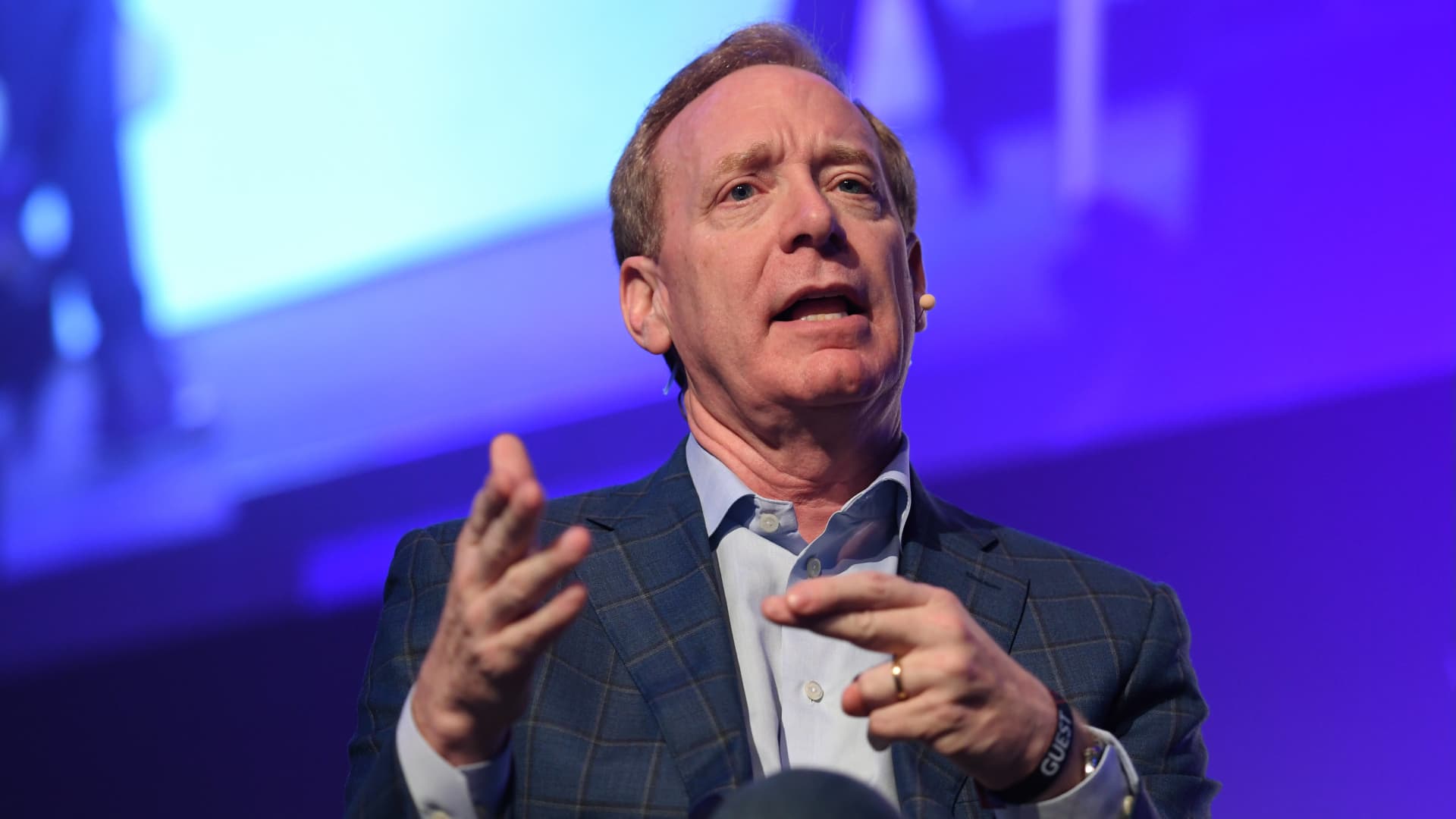

Essa preocupação parece ser uma pauta recente e está ganhando mais força entre as próprias pessoas ligadas a esse ramo, como por exemplo, Brad Smith, presidente da Microsoft, que defendeu que é necessário encontrar uma forma de desacelerar e até desligar a IA. Em uma entrevista dada ao El País, ele também se mostrou ser a favor da regulação do uso desenfreado da tecnologia.

Desligar

Olhar digital

O plano do executivo é criar uma espécie de alerta de segurança que consiga desativar a IA em situações de emergência. De acordo com Smith, uma IA descontrolada pode ser “uma ameaça existencial para a humanidade”.

“Precisamos ter uma forma de desacelerar ou desligar a IA, especialmente se está controlando um sistema de infraestrutura crítica”, disse ele na entrevista.

Outro ponto reforçado por ele é que irá ser melhor lidar com esse problema hoje antes que ele vire uma situação bem mais complicada no futuro.

Mesmo com essas questões, Smith reforça que se trata da “tecnologia mais importante criada desde a invenção da imprensa”, apesar de ela precisar de um controle maior. “Se essa é, como acho que é, a tecnologia mais avançada do planeta, precisamos de um nível de regulação que garanta a segurança”, disse.

A respeito do uso da IA em ferramentas como o Copilot, da Microsoft, o executivo disse que o assistente deve ser tido como um aliado para as tarefas criativas. “Acho que isso é que devemos pedir para todo mundo que usa essa tecnologia: usem para serem mais criativos, desenvolverem ideias. Porém, delegar ou externalizar o seu pensamento à máquina é um erro”, concluiu.

IA

Olhar digital

Essa preocupação de Smith não é uma coisa solo. Um levantamento foi feito na Yale CEO Summit desse ano, que aconteceu em junho, e mostrou que 42% dos CEOs que foram entrevistados disseram que a inteligência artificial tem um potencial de destruir a humanidade entre cinco e 10 anos.

Dos CEOs entrevistados, 34% disseram que a IA poderia destruir a humanidade em 10 anos, enquanto 8% apontaram que essa possibilidade poderia acontecer em cinco anos. Já 58% disseram que isso não é uma realidade e nunca poderá acontecer, por isso eles não estão preocupados.

Um outro ponto que o levantamento descobriu foi que 42% dos CEOs acreditam que a possibilidade de uma catástrofe feita pela inteligência artificial é exagerada. Mas 58% disseram que isso não é um exagero.

A preocupação é tão real que, no fim de maio de 2023, cientistas e empresários no comando de gigantes de tecnologia fizeram uma carta aberta, na qual diziam que era preciso que esforços fossem tomados no desenvolvimento da inteligência artificial para que ela não colocasse a humanidade em risco.

A carta foi assinada por Sam Altman, CEO da OpenAI; Demis Hassabis, chefe do Google DeepMind; Geoffrey Hinton e Yoshua Bengio, pesquisadores considerados “padrinhos” da IA moderna.

“Mitigar o risco de extinção pela IA deve ser uma prioridade global ao lado de outros riscos de escala social, como pandemias e guerras nucleares”, pontuava a carta.

Além do documento, recentemente Hilton expressou suas preocupações individuais com relação ao desenvolvimento da IA. “Sou apenas um cientista que de repente percebeu que essas coisas estão ficando mais inteligentes do que nós. Eu quero soar o alarme e dizer que devemos nos preocupar seriamente com como impedimos que essas coisas controlem a nós”, disse.

Ainda conforme ele, se a inteligência artificial ficar bem mais inteligente do que os humanos, ela poderá ser “muito boa em manipulação”, até em “contornar as restrições que impomos a ela”.

Na visão de Paul Christiano, um veterano na OpenAI, o caminho que está sendo percorrido pode levar a uma chance de 50/50 de acontecer uma catástrofe, em que a maior parte dos humanos pode acabar morta. Ele pontua que existe sim uma chance razoável de que a inteligência artificial se erga, bem no estilo Exterminador do Futuro, e acabe governando e, a depender, arruinando todos os humanos.

“Acho que talvez exista algo como uma chance de 10 a 20 por cento de uma tomada de poder pela IA, [com] muitos [ou] a maioria dos humanos mortos. No geral, talvez estejamos falando de uma chance de 50/50 de catástrofe logo após termos sistemas no nível humano”, disse ele no podcast Bankless.

E por que a visão dele tem que ser levada em consideração? Porque por muito tempo Christiano era o chefe da equipe de alinhamento de modelos de linguagem na OpenAI. Ou seja, as previsões dele não são alarmistas apenas para chocar as pessoas.

Atualmente, ele está comandando uma organização sem fins lucrativos chamada Centro de Pesquisa de Alinhamento. O objetivo deles é garantir que os sistemas de inteligência artificial sejam amigáveis e que eles tenham em mente os interesses humanos.

Fonte: Olhar digital, Terra, Mistérios do mundo

Imagens: Olhar digital

Post Anterior

Próximo Post

-

01Pesquisa diz que infertilidade masculina está ligada ao tamanho do ‘documento’

-

027 vezes em que pessoas criaram seu próprio idioma

-

0310 comportamentos tóxicos que podem existir em qualquer relacionamento

-

04HIV: mulher é curada após tratamento inovador

-

0516 imagens que mostram como era se divertir antes da internet existir

-

06Essa casa dobrável fica pronta em apenas 6 horas [Vídeo]

-

075 momentos ridículos e absurdos do último episódio de Game of Thrones

![Essa casa dobrável fica pronta em apenas 6 horas [Vídeo]](https://www.fatosdesconhecidos.com.br/wp-content/uploads/2018/10/5-73-350x262.jpg)